- ChatGPT to chatbot AI oparty na dużych modelach językowych (LLM). Najnowsze wersje, takie jak GPT-4 i GPT-4o, są znacznie bardziej zaawansowane niż wcześniejsze modele, takie jak GPT-3 – mają większe rozmiary, obsługują różne formaty danych i lepiej radzą sobie z rozumowaniem.

- GPT-4 radzi sobie z dłuższymi rozmowami i większymi wejściami dzięki ogromnemu oknu kontekstowemu, a nowsze wersje, jak GPT-4o, obsługują jednocześnie tekst, obrazy, dźwięk i wideo.

- Nowsze modele GPT, takie jak seria o1, mają na celu poprawę rozumowania poprzez analizę problemu krok po kroku przed wygenerowaniem odpowiedzi, co pozwala uzyskać jeszcze dokładniejsze wyniki.

Dlaczego pojawia się tyle nowych modeli?

Jeśli próbujesz wybrać, którego modelu ChatGPT użyć do swojego projektu, zrozumienie wszystkich różnic może być trudne.

Kiedy pojawił się GPT-4, całkowicie zdeklasował swojego poprzednika. Oto wszystko, co musisz wiedzieć o tym, jak GPT-4 wypada na tle GPT-3.

Czym jest ChatGPT?

ChatGPT to chatbot oparty na sztucznej inteligencji, zasilany przez duży model językowy (LLM) i opracowany przez OpenAI.

Wykorzystuje uczenie maszynowe i przetwarzanie języka naturalnego (NLP), aby rozumieć dane wejściowe i generować odpowiedzi – podobnie jak w rozmowie z człowiekiem.

GPT to skrót od Generative Pre-trained Transformer – zaawansowanej architektury sieci neuronowej używanej do trenowania LLM. Wykorzystuje ogromne ilości publicznie dostępnych danych z Internetu, by symulować ludzką komunikację.

Czym różni się GPT-3 od GPT-4?

1. Model 10x większy

GPT-3 ma 175 miliardów parametrów, podczas gdy GPT-4 aż 1,8 biliona.

Jak to możliwe? Architektura GPT-4 składa się z 8 modeli, z których każdy ma po 220 miliardów parametrów.

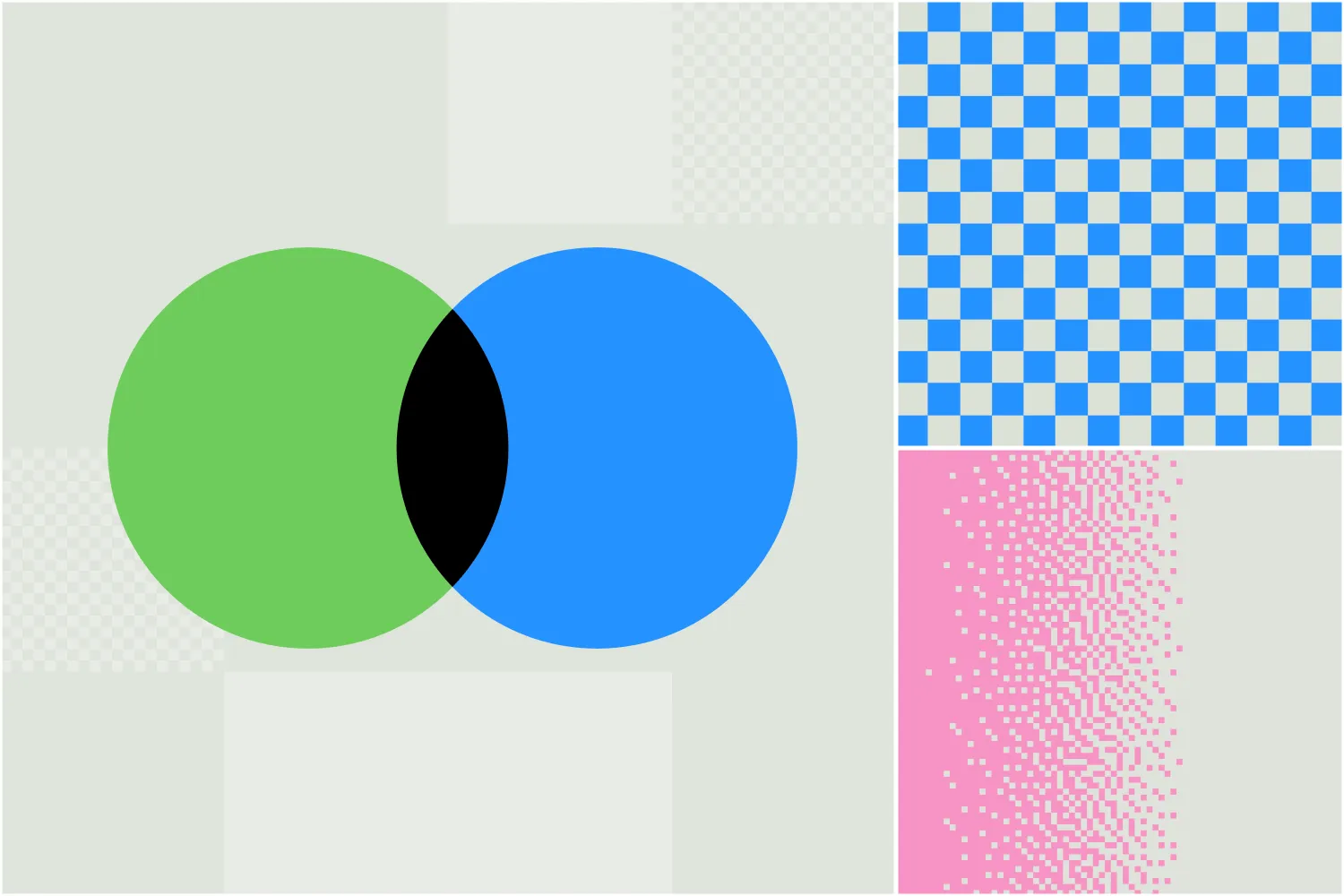

2. Obsługa wielu formatów danych

GPT-3 jest jednokanałowy, więc potrafi przetwarzać i generować tylko tekst.

GPT-4 natomiast potrafi przetwarzać zarówno tekst, jak i obrazy. A GPT-4o wprowadził obsługę tekstu, dźwięku, obrazu i wideo – jest więc znacznie bardziej wszechstronny niż poprzednik!

3. Znacznie większe okno kontekstowe

GPT-3 obsługuje okno kontekstowe o wielkości 2048 tokenów. GPT-4 – aż 128 tysięcy tokenów.

Okno kontekstowe to liczba tokenów tekstu, które model może przetworzyć naraz – im większe okno, tym więcej danych wejściowych można analizować.

4. Lepsze rozumowanie i rozwiązywanie problemów

Na wielu standaryzowanych testach GPT-3.5 plasował się w dolnych 10% zdających. Natomiast według testów OpenAI GPT-4 plasuje się w górnych 10% najlepszych wyników.

5. Ta sama cena

Zarówno modele GPT-3, jak i GPT-4 są dostępne bezpłatnie przez ChatGPT.

Do czego mogę użyć GPT?

Z odrobiną wyobraźni i wiedzy technicznej możliwości wykorzystania GPT w pracy i życiu codziennym są niemal nieograniczone. Firmy wykorzystują GPT do napędzania chatbotów sprzedażowych, oprogramowania HR, a nawet jako osobistych terapeutów.

Oto kilka najpopularniejszych sposobów, w jakie użytkownicy wykorzystują ChatGPT:

Asystent osobisty

Potrzebujesz kogoś, kto zajmie się codziennymi zadaniami bez zbędnych rozmów?

GPT może pomóc napisać e-maile, ustawić przypomnienia, zaplanować podróż czy podsunąć pomysł na obiad. To jak osobisty asystent, który nigdy się nie spóźnia i nie potrzebuje przerw na kawę.

Obsługa klienta

Masz dość odpowiadania na te same pytania w kółko? Coraz więcej firm korzysta z chatbotów obsługiwanych przez GPT do wsparcia klienta, aby odpowiadać na zapytania i rozwiązywać problemy. To jak agent wsparcia dostępny 24/7, który zawsze zna właściwą odpowiedź.

Tworzenie treści

Od wpisów na bloga po opisy w mediach społecznościowych – GPT pomoże Ci pisać szybciej i lepiej. Brakuje Ci pomysłów? Podpowie. Potrzebujesz gotowego szkicu? Też się tym zajmie. Nie zastąpi Twojego stylu, ale zdecydowanie przyspieszy pracę.

Analiza danych

GPT może podsumować raporty, wyciągnąć wnioski z arkuszy kalkulacyjnych czy pomóc zrozumieć złożone zbiory danych. To jak analityk, który wyłuskuje najważniejsze informacje.

Wsparcie przy programowaniu

Utkwiłeś przy problemie z kodem? GPT pomoże znaleźć błąd, zaproponuje ulepszenia, a nawet napisze cały skrypt. Boty do przeglądu i generowania kodu stały się codziennością dla programistów z różnych branż.

Historia modeli ChatGPT

Choć OpenAI stworzyło LLM-y GPT-2 i GPT-3, dopiero GPT-3.5 zaczęło zasilać ChatGPT.

GPT-3.5

Wydany w listopadzie 2022 roku, GPT-3.5 był pierwszym wprowadzeniem ChatGPT na świat.

GPT-3.5 Turbo

Model Turbo z 2023 roku poprawił dokładność odpowiedzi ChatGPT, choć wykorzystywał podobny model jak 3.5.

GPT-4

W marcu 2023 pojawił się bardziej zaawansowany model. W porównaniu do GPT-3, GPT-4 był mocniejszy i lepiej zoptymalizowany. Wprowadzono też ChatGPT Plus dla płacących użytkowników.

GPT-4 Turbo

W listopadzie 2023 roku OpenAI wypuściło wersję GPT-4 z dużo większym oknem kontekstowym niż jej poprzednik.

GPT-4o

GPT-4o został wydany w maju 2024 jako pierwszy prawdziwie multimodalny LLM od OpenAI. Litera „o” oznacza „omni”, czyli zdolność modelu do analizy i generowania tekstu, obrazów i dźwięku.

Co ważne, model 4o był dwa razy szybszy i o połowę tańszy od GPT-4 Turbo, a dostęp do niego uzyskali wszyscy użytkownicy ChatGPT (z limitem użycia).

GPT-4o Mini

Wersja Mini GPT-4o została wydana w lipcu tego samego roku. Koszty API były jeszcze niższe niż w oryginalnym modelu 4o, a zastąpiła GPT-3.5 Turbo jako domyślny model dla użytkowników ChatGPT.

OpenAI o1-preview

Najnowsza wersja od OpenAI to nowa seria o1, która zadebiutowała 12 września 2024 po długim okresie oczekiwania na premierę.

Model preview natychmiast pojawił się w ChatGPT, choć z niskimi limitami użycia.

Modele o1 to pierwsze LLM-y, które deklarują zdolność rozumowania. Jeśli model o1 otrzyma polecenie, nie odpowie od razu – stąd dłuższy czas oczekiwania.

Zamiast tego przechodzi przez każdy etap, dokładnie analizując każdą informację i jej konsekwencje, zanim zdecyduje o dalszym działaniu. Odpowiedź pojawi się dopiero po przemyśleniu całego ciągu kroków.

OpenAI o1-mini

o1-mini jest mniejszy niż o1-preview i o 80% tańszy. Został stworzony do codziennych zadań wymagających zaawansowanego rozumowania, takich jak programowanie czy matematyka.

GPT-5

Użytkownicy nie są pewni, czy najnowsza premiera o1 to następca czy poprzednik długo wyczekiwanego modelu GPT-5. Być może dopiero kolejna premiera OpenAI przyniesie odpowiedź.

Co to oznacza dla użytkowników i firm?

GPT-4 potrafi generować ogromne ilości treści w błyskawicznym tempie, co pozwala firmom automatyzować różne obszary działalności z pomocą sztucznej inteligencji.

Firmy, które wdrożą GPT-4, mogą automatycznie tworzyć treści, oszczędzając czas i pieniądze oraz zwiększając zasięg.

Ponieważ technologia ta obsługuje dowolny tekst, praktyczne zastosowania GPT-4 są niemal nieograniczone.

Jak GPT może rozwinąć mój biznes?

Skupienie się na funkcjonalności w GPT-4 przekłada się na większą efektywność operacyjną. Firmy mogą wykorzystać AI do rozbudowy wsparcia klienta, automatyzacji tworzenia treści, a nawet poprawy sprzedaży i marketingu.

GPT-4 daje firmom możliwość:

Tworzenia dużych ilości treści

Nowoczesne, zaawansowane modele językowe pozwalają firmom tworzyć wysokiej jakości treści w bardzo szybkim tempie. Przykładowo, firma może regularnie generować treści do mediów społecznościowych dzięki AI, utrzymując silną obecność online bez dużego nakładu pracy.

Usprawnienie obsługi klienta

AI zdolne do generowania odpowiedzi zbliżonych do ludzkich są niezwykle przydatne w obsłudze klienta. Dzięki jasnym odpowiedziom na pytania klientów, rozwiązania AI mogą obsłużyć większość typowych sytuacji wsparcia. To pozwala zmniejszyć liczbę zgłoszeń do supportu i daje klientom szybszy sposób uzyskania odpowiedzi.

Personalizacja doświadczenia marketingowego

Dzięki GPT-4 łatwiej tworzyć treści reklamowe dopasowane do różnych grup odbiorców. AI generuje spersonalizowane treści i reklamy, które lepiej trafiają do konkretnych użytkowników. To może zwiększyć współczynnik konwersji wśród internautów.

Tworzenie własnych chatbotów GPT

Możesz wykorzystać zaawansowane LLM na własne potrzeby – a budowa własnego chatbota jest prosta dzięki dedykowanym platformom.

Botpress to elastyczna i nieograniczenie rozbudowywalna platforma do chatbotów AI. Pozwala tworzyć dowolne chatboty lub agentów AI do każdego zastosowania.

Zintegruj swojego chatbota z dowolną platformą lub kanałem albo wybierz coś z naszej biblioteki gotowych integracji. Zacznij od tutoriali na kanale YouTube Botpress lub bezpłatnych kursów w Botpress Academy.

Rozpocznij budowę już dziś. To nic nie kosztuje.

Najczęstsze pytania

1. Czy GPT-4 był trenowany na tych samych danych co GPT-3?

Nie, GPT-4 nie był trenowany dokładnie na tych samych danych co GPT-3. Oba modele korzystają z dużych zbiorów danych z internetu, ale GPT-4 wykorzystuje bardziej zróżnicowany zestaw, obejmujący szerszy zakres językowy i wyższej jakości źródła, by poprawić dokładność faktów.

2. Jak OpenAI zapewnia, że nowsze modele, takie jak GPT-4, są bezpieczniejsze i lepiej dopasowane?

OpenAI dba o bezpieczeństwo modeli takich jak GPT-4, stosując techniki takie jak uczenie przez wzmacnianie z informacją zwrotną od ludzi (RLHF), wdrażając rygorystyczne filtry treści oraz przeprowadzając testy bezpieczeństwa, podczas których eksperci próbują znaleźć słabe punkty modelu przed jego udostępnieniem.

3. Czym są tokeny i jak przekładają się na rzeczywiste wykorzystanie?

Tokeny to fragmenty tekstu – zazwyczaj 4 znaki lub około ¾ słowa – używane do mierzenia długości wejścia i wyjścia w modelach GPT. Na przykład, "OpenAI is great!" to sześć tokenów. Liczba tokenów wpływa na koszt działania modelu oraz ilość kontekstu, jaką model może przetworzyć jednocześnie.

4. Dlaczego GPT-4 czasami nadal halucynuje lub wymyśla fakty?

GPT-4 halucynuje, ponieważ generuje tekst, przewidując najbardziej prawdopodobne sekwencje słów, a nie korzystając ze zweryfikowanej bazy danych. Jeśli brakuje mu kontekstu, może pewnie tworzyć wiarygodnie brzmiące, ale nieprawdziwe informacje.

.webp)